Intensivträning på bilder och data pågår just nu för att förbättra ai-stödd diagnostik.

Ur, The Economist, Technology Quaterly, 27 mars 2024, översatt av InPress. ©2024 The Economist Newspaper Limited. Alla rättigheter förbehållna.

Vad handlar artikeln om?

Att artificiell intelligens sedan ett bra tag hjälpt till att skapa bättre diagnoser är inget nytt, men det är nu utvecklingen är explosionsartad.

Barbara genomgick en regelbunden mammografiundersökning i januari 2023. Några veckor senare fick hon tid för ett läkarbesök på Aberdeen Royal Infirmary i Skottland. Resultatet av mammografiundersökningen såg bra ut enligt två läkare, men ett AI-system med namnet Mia hade upptäckt något: en sex millimeter stor fläck i avvikande grå nyanser. Det var cancer i stadium två. Hade upptäckten inte gjorts i det skedet och tumören avlägsnats, hade hon fått diagnosen först vid nästa screeningtillfälle – eller när sjukdomen gav sig till känna på annat sätt.

Den här typen av berättelser ger oss en känslomässig förståelse för hur artificiell intelligens kan ställa bättre diagnoser. Med hjälp av statistik kan vi få en bild av hur omfattande de positiva effekterna av AI är. Enligt uppgifter från den brittiska regeringen har tiden mellan sjukhusinläggning och behandling för strokepatienter minskat med mer än en timme. Detta tack vare e-Stroke, ett system som analyserar hjärnskanningar. e-Stroke har tagits fram av startup-företaget Brainomix, som ursprungligen var en verksamhet vid universitetet i Oxford. Man pekar på opublicerade data som visar att systemet är så snabbt att det medfört att antalet personer som uppnår en funktionsförmåga där de klarar sig utan hjälp efter en stroke har trefaldigats – från 16 till 48 procent.

Artificiell intelligens har tillämpats längre inom diagnostikområdet jämfört med inom andra delar av hälso- och sjukvården. Och det märks. Men den omställning AI erbjuder befinner sig i ett tidigt skede. De AI-system som hittills använts baseras på ganska enkel mönsterigenkänning. De ”grundmodeller” som fått stort genomslag sedan ChatGPT lanserades 2022, är bara i början av sin utvecklingsbana.

Jonathan Rothberg

Foto: Provided by 4Catalyzer

Den här revolutionen inleddes inom radiologi, den första typen av medicinsk bildteknik som blev helt digital. Omställningen innebar att det blev enklare att lagra och dela bilder. Man kunde också ta fram bilder som kunde läsas av maskiner. 2012 började maskinerna ta plats på riktigt, när ett neuronnät kallat AlexNet slog ut alla konkurrenter i den årliga tävlingen ”ImageNet challenge”.

Neuronnät, som är inspirerade av strukturen hos hjärnans syncentrum, är system där information flödar genom lager av ”neuroner” som är staplade ovanpå varandra. I tidiga varianter av neuronnät var alla neuroner i ett lager kopplade till alla neuroner i nästa lager. AlexNet var ett ”faltningsnätverk” – där kopplingarna var glesare. Det ger i sin tur utrymme för mer särskiljande former av analys.

Genom att kombinera den arkitekturen med nya processorer – som då ansågs ha enorm kapacitet – kunde AlexNet helt förändra området datorseende. Det skapade ökad potential för automatisering på radiologiområdet och senare även inom dermatologi, oftalmologi och flera andra områden.

AlexNets efterföljare används i allt större utsträckning som komplement till, och ibland i stället för, mänsklig expertis i form av radiologer. Capio S:t Görans sjukhus i Stockholm använder exempelvis ett AI-system från det sydkoreanska företaget Lunit som ett ”andra par ögon” på sin radiologiavdelning. På så sätt behöver resultaten av mammografiundersökningar inte granskas av två olika röntgensjuksköterskor. I Danmark används Transpara, en produkt från det nederländska företaget ScreenPoint Medical, vid en första granskning av mammografiresultat i lågriskfall.

Att kunna ställa fler diagnoser med färre läkare är en positiv utveckling globalt, men i fattiga länder kan det visa sig vara än mer välkommet. Det japanska företaget Fujifilm har byggt en batteridriven röntgenmaskin som väger 3,5 kg. När den kombineras med AI-algoritmer från det indiska företaget Qure.ai kan den användas för att utföra tuberkulosscreening på landsbygden i Nigeria. Maskinen kan också användas för screening av flera andra sjukdomar, som lunginflammation, KOL (kroniskt obstruktiv lungsjukdom) och hjärtsvikt.

I en ännu mer ambitiös ansats bygger Darlington Akogo hos MinoHealth Labs i Ghana en radiologimodell tränad på bilder från hela Afrika. Är det att hoppas för mycket att ett diagnosverktyg ska kunna utvecklas ur den här processen? ”Vi kan väl säga att vi siktar mot stjärnorna”, säger dr Akogo. ”Även om vi inte når ända dit, får vi ändå ett verktyg som stöd inom radiologin.”

Vissa AI-system kan tolka bilder som tagits med hjälp av lägre strålning än normalt. Det leder både till att det behövs färre läkare för att tolka en röntgenbild och att det krävs en lägre strålningsdos för att framställa den. Det är positivt för patienterna. Systemen kan också leta efter sådant som läkare inte skulle kontrollera. Vid ”opportunistisk screening” genomsöks en röntgenbild, som tagits för att leta efter ett specifikt problem, även efter tecken på andra avvikelser.

Merparten av de 80 miljoner datortomografiundersökningar som årligen görs i USA söker efter ett problem i en viss del av kroppen, men de innehåller nästan alltid information också om andra kroppsdelar. Läkarna vill inte skicka runt bilder som tagits i ett visst syfte till sina kollegor för att de eventuellt skulle kunna upptäcka något helt annat. För maskiner är det enkelt att göra flera saker samtidigt och de kan bli experter på att identifiera många olika typer av sjukdomar.

Ultraljudssystem erbjuder en annan möjlighet för AI. Det amerikanska företaget Butterfly tillverkar ett bärbart ultraljudssystem som tack vare inbyggd AI kan användas för att bedöma högriskgraviditeter och beräkna förlossningsdatum, fostervikt och mängden fostervatten. Den typen av mätningar är annars inte möjliga att göra utanför kliniken och de kräver normalt flera olika instrument.

Enligt Bill & Melinda Gates Foundation är Butterflys ultraljudssystem en möjlighet att pressa ned den höga mödradödligheten i Afrika söder om Sahara, som annars varit svår att få bukt med. Sådana AI-förstärkta system – Philips och GE Healthcare finns också på marknaden – kan bidra på andra områden än mödravård, exempelvis inom kardiologi, akutsjukvård och ortopedi. Hundratals av Butterflys system används i Ukraina för att hjälpa räddningspersonal att bedöma olika krigsskador.

Andra instrument kan också uppdateras tack vare AI. Läkare inom primärvården i London testar ett AI-aktiverat stetoskop för att se om det kan ge bättre diagnoser vid vissa former av hjärtsjukdom. I Oxford görs försök där man jämför mätningar av lungfunktionen med hjälp av en AI-driven spirometer med tidigare tekniker för att ställa diagnosen KOL.

Forskaren, ingenjören och entreprenören Jonathan Rothberg, som grundade Butterfly, är också en av grundarna av Hyperfine, som tillverkar en innovativ bärbar MR-maskin (magnetisk resonanstomografi) med namnet Swoop. Dess AI-kapacitet gör att den kan göra en bedömning baserad på data som samlats in genom användning av jämförelsevis svaga magnetfält. Eftersom låg fältstyrka är enklare att generera, kan Swoop placeras vid patientens säng och behöver inte installeras i ett särskilt rum, som MR-maskiner med hög fältstyrka.

I andra änden av skalan användes AI av det New York-baserade företaget EZRA för att sänka kostnaderna för resonanstomografi av hela kroppen som ett verktyg vid cancerscreening. Med hjälp av högfältsmagneter och egenutvecklad AI har skanningarna blivit snabbare och därmed billigare. En 30-minutersskanning kostar 1 350 dollar och målet är att sänka kostnaden till 500 dollar. I priset ingår en AI-genererad redogörelse för resultatet.

En av fördelarna med AI-system är att de kan tränas på betydligt mer data än en läkarstudent klarar att ta in. Microsoft samarbetar med Paige, ett företag som utvecklar AI för patologer, för att ta fram ett bildbaserat AI-verktyg för cancerdiagnoser som matas med flera miljarder bilder. En patolog som tittar på en bild i sekunden och har hundra liv skulle inte kunna samla på sig samma mängd erfarenhet.

Sharief Taraman säger att han i rollen som barnneurolog kan möta tusentals barn. Men den AI som hans Silicon Valley-baserade företag Cognoa har byggt för att utreda autism hos barn, har tränats på filmer av hundratusentals barn. Det gör att systemet kan använda en video som föräldrarna laddar upp, tillsammans med ett frågeformulär, för att komma fram till en diagnos.

Det handlar inte heller om att enbart ställa en diagnos. Den måste också vara rätt. Med AI finns det en möjlighet att ligga på samma nivå som eller överträffa det resultat som människor kan uppnå.

Exempelvis verkar artificiella intelligenser vara bättre än patologer på att bedöma om en prostatacancer är godartad eller elakartad. Men det tar tid att visa att ett system är tillräckligt bra. Just nu genereras algoritmer så snabbt att det är svårt att hinna få dem testade och godkända. Hugh Harvey leder det brittiska företaget Hardian Health som utvärderar medicintekniska produkter. Han säger att det idag tar minst två år för medicinteknisk utrustning att få ett myndighetsgodkännande, från start till mål.

När det gäller den brittiska regeringens planer för en snabbare implementering av AI vid diagnostisering av lungcancer, menar David Baldwin, gästprofessor i medicin vid Nottingham University, att i två utvärderingar som nyligen publicerades kunde man inte bekräfta noggrannheten och den kliniska effekten hos dessa omtalade verktyg. ”Det här är ett exempel på att utvecklingstakten är för snabb för att den långsammare utvärderingsprocessen ska kunna hålla jämna steg. Det krävs mycket arbete för att säkerställa att de nya verktygen kan lanseras på ett säkert sätt”, säger han.

2019 gjordes en systematisk genomgång av den diagnostiska noggrannheten hos 82 algoritmer inom medicinsk bildteknik. Slutsatsen var att bedömningsprocessen ofta hade varit av låg kvalitet. Särskilt oroväckande var avsaknaden av prospektiva studier som tittar på effekter efter ett ingripande – i motsats till retrospektiva studier som börjar med ett resultat och går tillbaka för att titta på vad som föregick det.

En av anledningarna till att detta spelar roll, är att prospektiva studier är bättre på att fånga upp ”falskt positiva resultat” – fall där ett system pekade ut en avvikelse, utan att det stämde. Gerald Lip är rådgivande radiolog vid NHS Grampian i Skottland och han har kommit fram till att vissa algoritmer, som Mia, är lika bra eller bättre än människor på att upptäcka bröstcancer.

Men det sker fortfarande på bekostnad av flera falskt positiva resultat. Det beror delvis på att de enbart arbetar med bilder, medan läkare också har andra informationskällor. Falskt positiva resultat är ett problem för patienterna eftersom de skapar oro och innebär potentiellt smärtsamma, till och med farliga, uppföljande undersökningar. De medför också problem för sjukvårdssystemet, eftersom de driver upp kostnaderna.

Om AI i större utsträckning ska kunna användas för ”opportunistisk screening” av andra saker när en bild tas fram för ett specifikt syfte, måste andelen falskt positiva resultat vara mycket låg. Detsamma gäller för övrigt för alla metoder för screening av symptomfria individer. När Eric Topol, chef för Scripps Research Translational Institute i San Diego, tittar på system som EZRA – som används för att skanna hela kroppen hos normalt friska individer – oroar han sig över potentialen för oväntade fynd. De kan leda till ”omfattande undersökningar som medför risker och kostnader”, för att sedan upptäcka att det inte fanns någon cancer.

Daniel Sodickson, vetenskaplig chefsrådgivare hos EZRA, säger att oväntade fynd ska följas upp med ny bilddiagnostik för att se om något förändras. Det kommer att krävas många bra belägg för att denna strategi ger utdelning om skeptiker som dr Topol ska låta sig övertygas.

Utvecklingen är på väg åt rätt håll. När AI blir vanligare vill de som betalar för användningen ha tillförlitliga data så att de kan avgöra om tekniken är lönsam. Prospektiva studier av hög kvalitet tar tid och därför finns det förstås inte så många sådana ännu. Andra problem som uppmärksammades i studien från 2019 – i vissa tester användes de data som systemet tränades på, snarare än data som det inte hade sett tidigare – bör bli mindre vanliga allt eftersom fältet utvecklas.

Det finns självfallet entreprenörer som ogillar utvärderingsprocesser som är tidskrävande för dem och deras patienter. Dr Taraman oroar sig över att det kan bli dyrt om man dröjer med att införa en bredare användning av tester för autism. Om de här barnen inte får en tidig diagnos ”missar man ett möjlighetsfönster och det får livslånga konsekvenser”.

Genom att notera mycket små förändringar i ögats blodkärl verkar modellen också kunna peka ut sjukdomstillstånd som Parkinsons sjukdom och stroke.

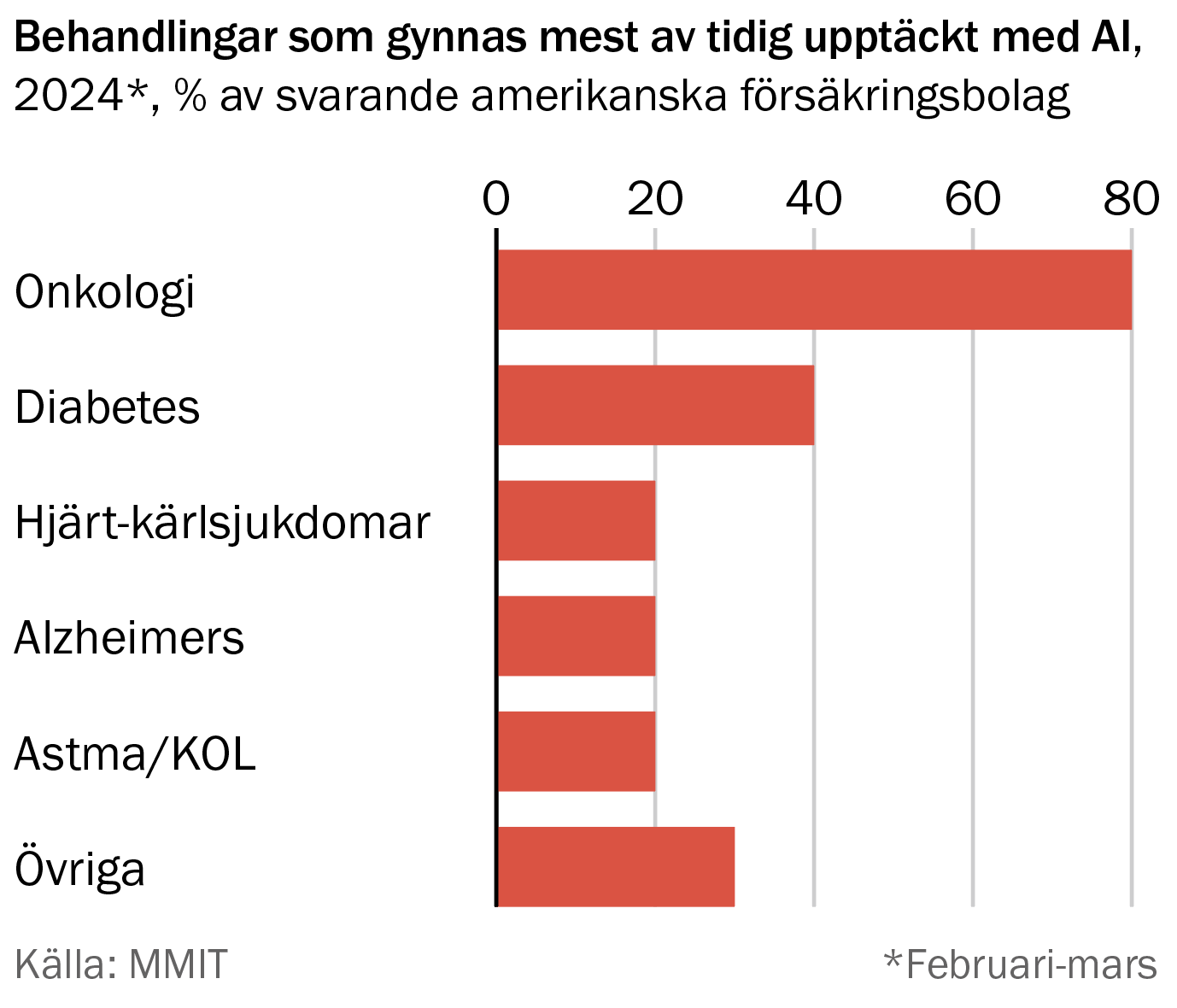

En ny generation av grundmodeller som är tränade på många olika datakällor – inte bara bilder och stora textmängder – kan sannolikt göra verktygslådan ännu bredare. De här modellerna kräver inte att de enorma mängder data som de tränas på ska vara märkta. De har kapacitet för ”självövervakad” inlärning och det kan tillämpas på bilder, genomikdata, data om genuttryck, metabola data, elektroniska journaler, blodprov och frågeformulär om livsstil och familjehistorik.

Grundmodeller kan erbjuda mer än möjligheter till bättre diagnoser av befintliga tillstånd. De kan också komma att bidra med en tidig förvarning om tillstånd som ännu inte manifesterats, som cancer, hjärtsjukdom eller diabetes (se diagram). 2022 visade kinesiska forskare att den här typen av modell kunde förutspå risker för allvarlig sjukdom hos patienter med covid. Så mycket sagt, måste tillämpningen av AI vara noggrann och fokuserad för att säkerställa att modellerna inte för in eller förstärker systematiska fel.

Pearse Keane

Foto: Moorfields Eye hospital

Denna nya teknik har först nyligen börjat göra avtryck på medicinområdet. I en studie som publicerades i Nature 2023 konstaterades att det beror på att tekniken är så ny och att det är svårt att få tillgång till stora och varierande mängder medicinska data, trots att det finns massor av text och video att tillgå på internet, framför allt om man inte är så petig med upphovsrätten. Det ger resursstarka företag en fördel – därav det stora intresset för Microsofts samarbete med Paige om en modell för cancerdiagnoser.

Forskare vid Moorfields Eye Hospital i London har använt AI inom oftalmologi sedan 2016. I september förra året publicerade Pearse Keane och hans kollegor vid Moorfields och University College London en grundmodell för bilder av näthinnor som tagits fram med Google DeepMind. RETFound, som förtränades på över en miljon bilder innan den visades märkta bilder av tillstånd som diabetesretinopati och glaukom, kan fatta beslut på expertnivå om att remittera patienter med olika ögonsjukdomar. Genom att notera mycket små förändringar i ögats blodkärl verkar modellen också kunna peka ut sjukdomstillstånd som Parkinsons sjukdom och stroke. Dr Keane säger att tekniken kan vara allmänt tillgänglig som öppen källkod inom två till tre år.

Denna text publicerades ursprungligen i det tryckta magasinet Världen Om juni 2024. Översättare: Helen Gustafsson

Läs fler artiklar från samma nummer här.

Så här jobbar Världen Om med kvalitetsjournalistik: Vi väljer ut artiklar. analyser, data och intervjuer från The Economist som täcker in geopolitik, vetenskap, livsstil, affärer och kultur. The Economist har funnits sedan 1843 för att "stärka kampen för intelligent upplysning i syfte att motverka okunskap som hindrar framsteg och utveckling."